Filipe Pequito 7 minutos de leitura

O caráter revolucionário do mais recente update ao algoritmo do Google, que tem influência no SEO do seu website, chegou pelas palavras do próprio vice-presidente da área de Search, Pandu Nayak: "o BERT é a atualização mais importante dos últimos 5 anos".

O novo modelo consegue entender melhor as particularidades dos idiomas, incluindo o português. Agora, o motor de pesquisa não analisa apenas os termos palavra por palavra e passa a considerar também o contexto da própria frase.

Com isto, o Google revelou que 1 em cada 10 páginas de resultados irá ser impactada.

Perceba como no nosso artigo e de que forma deve preparar a sua presença online para esta revolução na linguagem digital.

Clique para navegar:

- O que é o algoritmo de pesquisa BERT?

- Exemplos dos resultados com o modelo BERT

- Qual o objetivo principal desta atualização?

- Como otimizar o seu website para o BERT?

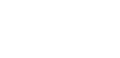

O que é o algoritmo de pesquisa BERT?

O algoritmo BERT parece ser uma novidade, mas, na verdade, já foi lançado em 2018.

O gigante das pesquisas introduziu, em código aberto (open source), uma técnica de pré-treino de processamento da linguagem natural baseada em redes neurais, ou seja, com foco na neurolinguística das pesquisas.

Os modelos gerados permitiram analisar uma frase como um todo e não apenas como a junção de palavras soltas, ignorando alguns termos ou palavras de ligação.

Se está familiarizado com a importância do SEO e acompanha as novidades, deve estar a questionar-se quanto ao futuro do algoritmo RankBrain - que já na altura, em 2015, tinha começado o seu caminho para a compreensão da linguagem humana.

Este não vai ser substituído. Na verdade, os dois algoritmos complementam-se.

RankBrain e BERT: os algoritmos que vão trabalhar em conjunto

O RankBrain foi o primeiro sistema baseado na Inteligência Artificial (AI) e Machine Learning (ML).

O objetivo era melhorar os resultados da pesquisa e saber interpretar novas pesquisas, ou seja, termos que nunca tinham sido pesquisados.

Parece incrível, mas segundo o próprio vice-presidente do Google Search, 15% dos milhares de milhões de pesquisas feitas todos os dias são uma novidade para a empresa – logo, para os algoritmos também.

O BERT vem, assim, complementar o RankBrain, funcionando como um método adicional para melhor compreender os conteúdos e as pessoas.

Caso seja necessário, podem atuar em conjunto, da mesma forma que já acontece com os corretores de grafia na barra de pesquisa ou a capacidade que o Google tem para identificar os sinónimos de uma palavra.

Feito o disclamer, vamos então explorar os exemplos e ver na prática, o que muda com o BERT.

Exemplos dos resultados com o modelo BERT

Há muitos significados para uma só palavra.

O ser humano consegue perceber o sentido através do contexto e distinguir entre banco (onde nos sentamos) e banco (onde deposita os lucros da sua empresa).

No seu press release, Pandu Nayak deu alguns exemplos dos resultados com o update ao algoritmo do Google.

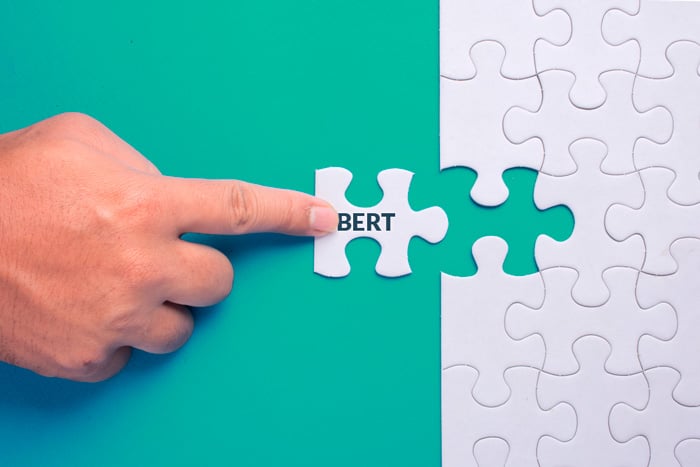

Exemplo 1

Fonte: Blog Google

Na frase, "Can you get medicine for someone pharmacy", o algoritmo ignorava e nem sequer considerava a importância da preposição "for" (“para” em português) - que altera radicalmente o significado da frase. E logo, os resultados devolvidos pela pesquisa.

O novo modelo BERT é mais certeiro ao processar as palavras na sua relação com a frase – neste caso, dá significado à expressão “for someone”.

O modelo BERT também está a ser utilizado para melhorar os Featured Snippets em mais de 20 países. Os resultados têm demonstrado melhorias na precisão dos resultados em línguas como o português, coreano e hindu.

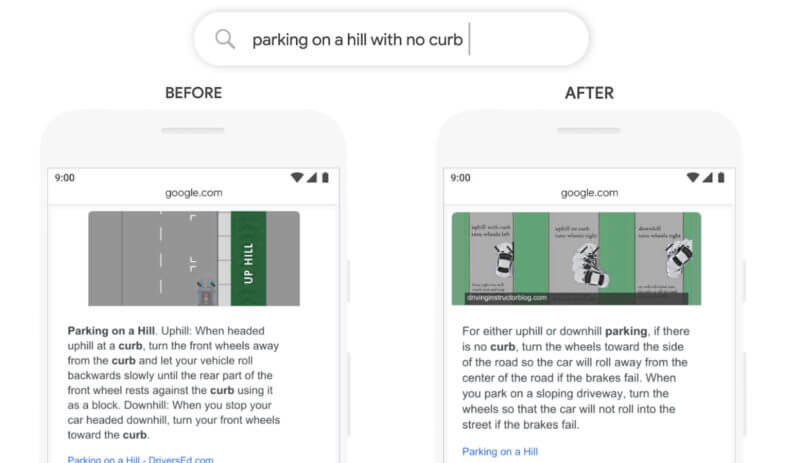

Exemplo 2

Fonte: Blog Google

Este exemplo referido pelo vice-presidente do Google Search refere-se a uma pesquisa sobre manobras de skate e como fazer uma curva sem travão.

Quando antes o algoritmo ignorava o "no" (“não” em português) e gerava um resultado genérico e impreciso, agora tem em atenção o advérbio e consegue devolver a resposta exata à pesquisa.

Existem muitas outras pesquisas que certamente vão mudar com o update deste algoritmo.

Posto isto, o que deve fazer com o novo algoritmo e como otimizar para o BERT? Talvez não precise de fazer nada (leia o artigo até ao fim para perceber o que queremos dizer).

Qual o objetivo principal desta atualização?

Saber ler nas entrelinhas exige mais do que dominar a leitura.

Até para os humanos, algumas nuances da língua podem ser difíceis de entender. Por exemplo, na língua portuguesa: "ir ao encontro" tem um significado diferente de "ir de encontro".

A primeira significa que algo se aproxima de outra coisa (ex.: a ideia dela vai ao encontro da minha). Já a segunda expressão significa um movimento violento ou um choque implícito (ex.: ela foi de encontre ao poste). Mesmo assim, muita gente comete este erro.

São as pequenas palavras - tais como "ao" e "de" - que fazem a diferença nos resultados que são devolvidos nas pesquisas, uma vez que modificam o seu sentido.

O mais recente algoritmo do Google passa a processar as palavras no contexto de uma frase, ou seja, entende como se relacionam entre si.

Como resultado, atribui ao termo de pesquisa um significado real, que vai ao encontro do que o utilizador procura.

Pense, por exemplo, nos diferentes significados da palavra “baixo” em português:

Nome

- Baixo: parte inferior (diferente de “cume” ou “cimo”)

- Baixo: local mais fundo (igual a “depressão”)

- Baixo: instrumento musical

- Baixo: cantor que dá notas mais graves

Adjetivo

- Baixo: Que tem menos altura (diferente de “alto”)

- Baixo: Que tem pouca profundidade (diferente de “alto”)

- Baixo: Que tem valores inferiores ao que é considerado normal

- Baixo: Que tem pouca importância numa escala hierárquica

- Baixo: Que provoca desprezo (igual a “desprezível”, “ignóbil” ou “vil”)

Advérbio

- Baixo: Em lugar pouco elevado

Depois destes exemplos, é fácil perceber a importância de entender a palavra no contexto da frase.

E... como consegue este nível de exatidão?

Processando e analisando as palavras que surgem antes e depois para decifrar a verdadeira intenção na essência da pesquisa.

O modelo BERT de processamento da linguagem natural:

- Valoriza perguntas e pesquisas mais conversacionais e feitas de forma natural;

- Melhora a análise de palavras-chave longas;

- Passa a usar TODOS os termos da frase que compõe a pesquisa;

- Devolve resultados mais relevantes e precisos, que correspondem à intenção de pesquisa.

Existe ainda outra qualidade do novo algoritmo. O sistema não é estático, ou seja, aprende com a experiência e as pesquisas feitas por nós, pelos humanos, e aperfeiçoa os resultados.

Como otimizar o seu website para o BERT?

Ao contrário do que poderia pensar, não existe uma forma de otimizar o conteúdo do seu website para este update.

O único conselho do Google é o mesmo de sempre: continue a produzir conteúdo de qualidade de forma a que consiga chegar às suas buyer personas.

A página do seu website e os artigos do blog foram escritos de pessoas para pessoas? O conteúdo está atualizado e ajuda os utilizadores e/ou potenciais clientes a resolverem um pain point?

Se respondeu afirmativamente a estas duas questões, apenas precisa de ficar vigilante.

O conteúdo que a sua empresa publica nos seus diferentes canais de comunicação deve estar otimizado para SEO, mas de uma forma natural para que esteja em sintonia com as boas práticas valorizadas pelo BERT.

Face às novidades, recomendamos que:

- Verifique o tráfego para as diferentes páginas do seu website;

- Analise as suas métricas e veja se há alterações;

- Tenha especial atenção às suas pillar pages e determine quais foram impactadas e para que tipo de pesquisas;

- Verifique se o conteúdo está a ser útil para os termos de pesquisa.

Para além de ser especialista em SEO, a Made2web é Google Partner e está a par de todos os updates aos algoritmos. Fale connosco, conquiste leads qualificadas no seu website e aumente as suas vendas.

Tenha uma Proposta para SEO >

Conteúdo

Categoria: SEO